摘要:本文分享了深度学习模型调参的经验,重点介绍了RNN(循环神经网络)和CNN(卷积神经网络)的实践洞察。通过调整模型参数,可以优化模型的性能并提高其准确性。本文旨在帮助读者了解在深度学习模型调参过程中需要注意的关键点,以及RNN和CNN在实践中的优势和挑战。通过本文的分享,读者可以更好地理解深度学习模型的调参过程,并能够在实践中应用所学知识。

本文目录导读:

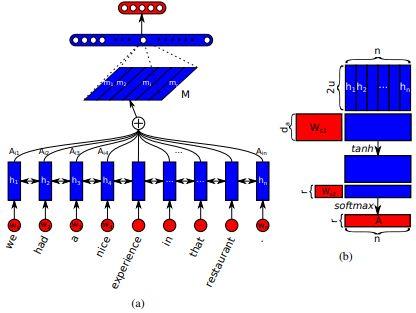

深度学习(Deep Learning)已成为现代机器学习领域的重要分支,其中循环神经网络(RNN)和卷积神经网络(CNN)是最常用的两种模型,在实际应用中,如何对这两种模型进行参数调整,以优化其性能,是每个数据科学家和机器学习工程师必须面对的挑战,本文将分享一些我在RNN和CNN调参过程中的经验。

循环神经网络(RNN)调参经验

1、序列长度与时间步长:在处理序列数据时,需要选择合适的序列长度和时间步长,过长的序列可能导致模型训练困难,过短的序列则可能忽略重要信息,时间步长的选择也影响模型的性能,需要根据具体任务进行调整。

2、门控机制选择:RNN有多种门控机制,如LSTM、GRU等,需要根据任务特性选择合适的门控机制,LSTM在处理长期依赖问题上表现较好,而GRU则更适合于资源有限的场景。

3、网络层数:增加网络层数可以提高模型的表达能力,但也可能导致训练难度增加,需要根据数据集大小和任务复杂度来选择合适的网络层数。

4、学习率与优化器:选择合适的学习率和优化器对模型训练至关重要,较小的学习率有助于模型稳定,而优化器的选择则根据任务特性来决定,如Adam、SGD等。

卷积神经网络(CNN)调参经验

1、卷积层参数:卷积层的卷积核大小、步长、填充方式等都会影响模型的性能,需要根据数据集特性和任务需求来调整这些参数。

2、池化层选择:池化层有助于降低数据维度,提高模型的鲁棒性,常见的池化方式有最大池化、平均池化等,需要根据任务需求选择合适的池化层。

3、网络深度与宽度:增加网络深度和宽度可以提高模型的性能,但也可能导致过拟合和训练难度增加,需要在保证模型性能的前提下,尽量控制网络的复杂度。

4、激活函数:选择合适的激活函数可以提高模型的非线性表达能力,常见的激活函数有ReLU、Sigmoid、Tanh等,需要根据任务特性和数据集特性来选择。

调参策略与建议

1、初始化参数:合理的初始化参数有助于模型训练,可以采用随机初始化、预训练等方式。

2、使用迁移学习:对于某些复杂任务,可以直接使用在大型数据集上预训练的模型,然后进行微调。

3、数据增强:通过数据增强来增加数据集的大小和多样性,有助于提高模型的泛化能力。

4、早期停止训练:在验证集上,当模型性能达到饱和或开始下降时,应停止训练,避免过拟合。

5、超参数搜索与优化:可以采用网格搜索、随机搜索、贝叶斯优化等方法来寻找最佳超参数。

RNN和CNN的调参是一个复杂且富有挑战性的过程,需要根据数据集特性、任务需求以及模型特性来选择合适的参数,还需要不断尝试新的调参策略和方法,以提高模型的性能,希望本文的分享能对大家在RNN和CNN调参过程中有所帮助。

沪ICP备19034891号-1

沪ICP备19034891号-1